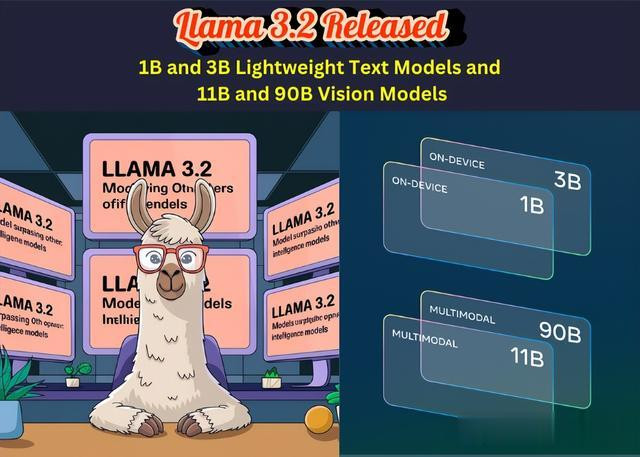

【新智元导读】Meta首个贯穿图文的多模态Llama 3.2来了!此次仁科百华qvod,除了11B和90B两个基础版块,Meta还推出了仅有1B和3B轻量级版块,适配了Arm处理器,手机、AR眼镜旯旮成立皆可用。

Llama 3.1超大杯405B刚昔时两个月,全新升级后的Llama 3.2来了!

此次,最大的亮点在于,Llama 3.2成为羊驼眷属中,首个援救多模态才调的模子。

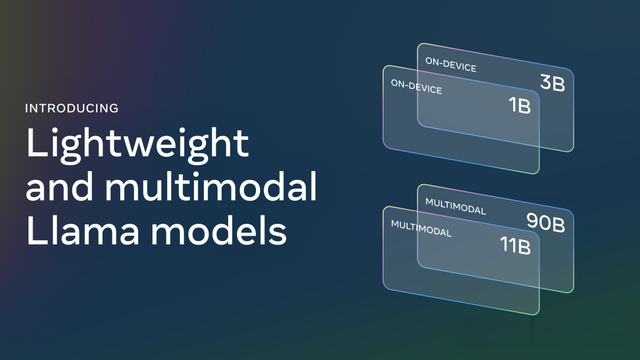

Connect大会上,新出炉的Llama 3.2包含了袖珍(11B)和中型(90B)两种版块的主要视觉模子。

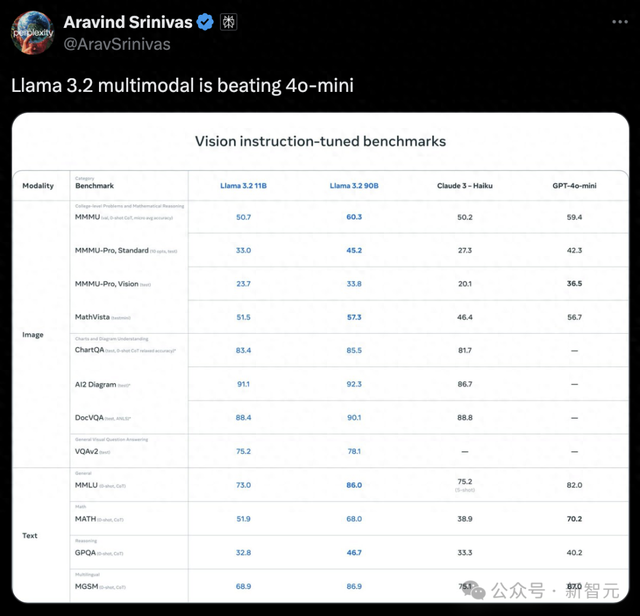

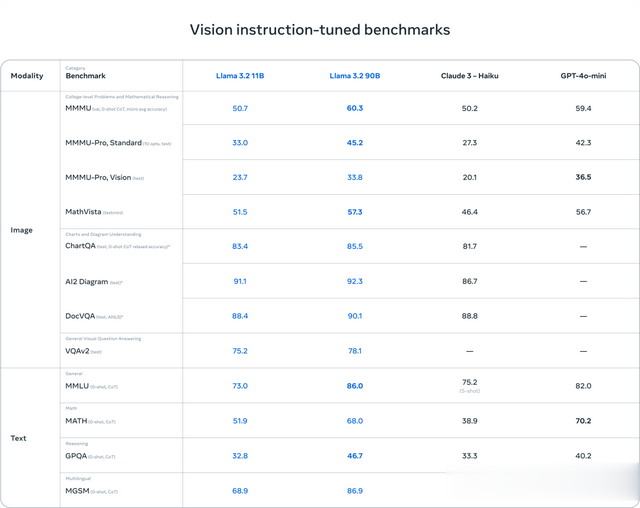

正如Meta所说,这两款模子八成凯旋替代,相对应的文本模子,而况在图像贯穿任务上打败了闭源Claude 3 Haiku。

以致,90B版块打败了GPT-4o mini。

就连英伟达高档科学家Jim Fan都不禁夸赞,在轻量级模子中,开源社区合座上并不过时!

同期,为了适配旯旮狡计和结尾成立,Meta还推出了1B和3B两个轻量级纯文本的版块,可援救128K波折文。

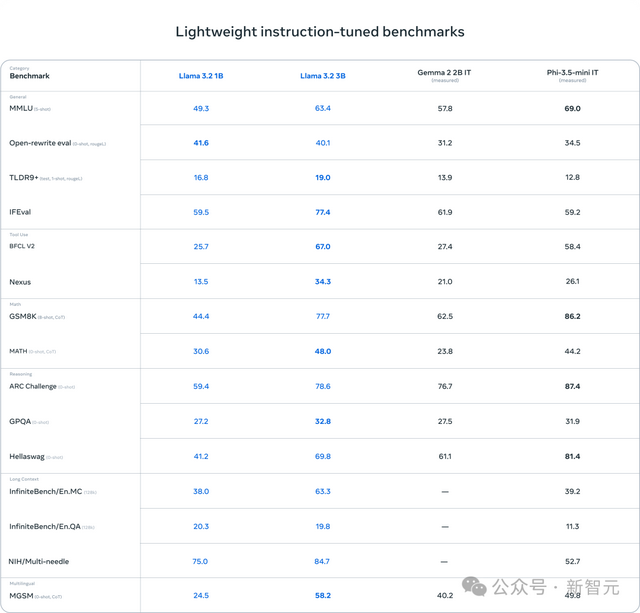

别看参数少,1B/3B在讲究摘要、指示撤职、重写等任务上,表现相称出色,而况专为Arm处理器作念了优化。

LeCun振作地暗意,「可人的大羊驼宝宝来了」!

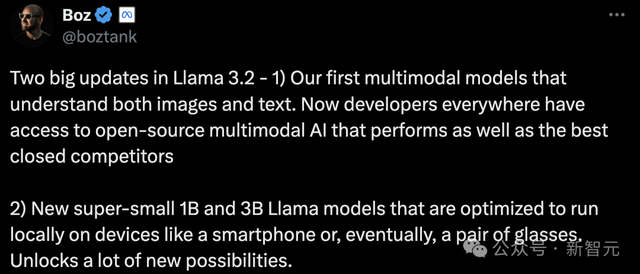

Meta首席技艺官对Llama 3.2的发布,作念了两大亮点讲究:

首个既能识别图像,又能贯穿文本的多模态模子。最遑急的是,八成失色闭源模子

超轻量1B/3B模子,解锁更多结尾成立可能性

有网友对此点评说念,这可能是编削游戏规章的朝上,旯旮成立AI正在壮大。

才调一览

11B和90B这两款模子,不仅援救图像推理场景,包括图表和图形在内的文档级贯穿、图像描摹以及视觉定位任务,而况还能基于现存图表进行推理并快速给出讲述。

比如,你不错问「前年哪个月销售事迹最佳?」,Llama 3.2就会凭据现存图表进行推理,并飞速给出谜底。

轻量级的1B和3B模子则不错匡助不仅在多话语文本生成和器具调用才调方面表现出色,而况具有高大的隐讳保护,数据弥远不会离开成立。

之是以在土产货运行模子备受巨匠的意思,主要在于以下两个主要上风:

领导词和反应八成给东说念主一会儿完成的嗅觉

应用环节不错明晰地死心哪些查询留在成立上,哪些可能需要由云霄的更大模子处理

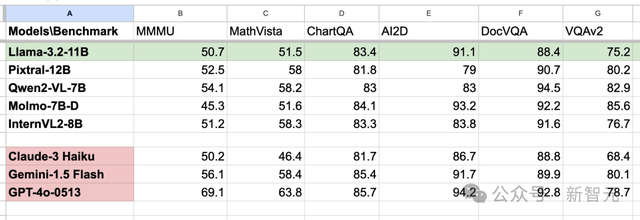

性能评估

收尾表示,Llama 3.2视觉模子在图像识别等任务上,与Claude 3 Haiku和GPT-4o mini不相波折。

3B模子在撤职指示、讲究、领导词重写和器具使用等任务上,表现优于Gemma 2 2B和Phi 3.5 mini;而1B模子则与Gemma旗饱读至极。

视觉模子

当作首批援救视觉任务的Llama模子,Meta为11B和90B型打造了一个全新的模子架构。

在图像输入方面,历练了一组适配器权重,将预历练的图像编码器集成到预历练的假话语模子中。

具体来说,该适配器:

由一系列交叉详确力层构成,负责将图像编码器的暗意输入进假话语模子

通过在文本-图像对上的历练,杀青图像暗意与话语表征的对皆

在适配器历练期间,Meta会对图像编码器的参数进行更新,但不会更新假话语模子参数。

也便是说,模子的纯文本才调便不会受到任何影响,而设备者也不错将之前部署的Llama 3.1无缝替换成Llama 3.2。

具体的历练经由如下:

当先,为预历练的Llama 3.1文本模子添加图像适配器和编码器,并在大范围噪声图像-文本对数据上进行预历练。

然后,在中等范围的高质料范围内和常识增强的图像-文本对数据上,再次进行历练。

接着,在后历练阶段接收与文本模子肖似的法子,通过监督微调、拒却采样和凯旋偏好优化进行多轮对皆。并加入安全缓解数据,保险模子的输出既安全又实用。

这在期间,模子所使用的高质料微调数据,恰是来自合成数据生成技艺——使用Llama 3.1模子在范围内图像的基础上过滤和增强问题谜底,并使用奖励模子对通盘候选谜底进行排序。

最终,咱们就能得到一系列不错同期收受图像和文本领导词的模子,并八成潜入贯穿和对其组合进行推理。

对此,Meta高傲地暗意暗意:「这是Llama模子向更丰富的AI智能体才调迈进的又一步」。

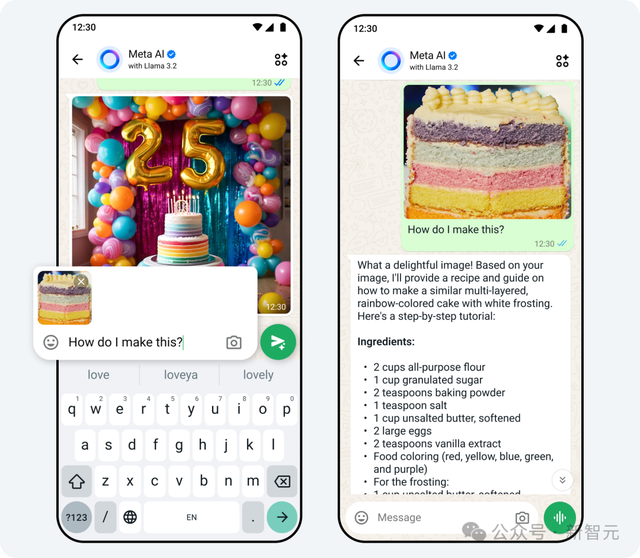

得到全新Llama 3.2加执的助手Meta AI,在视觉贯穿力上相称强。

比如,上传一张切开的诞辰蛋糕图片,并问它制作配方。

Meta AI便会给开端把手教程,从配意象加工阵势,一应俱全。

又或者你发给它一张小羊的相片,并条款将其放在冲浪板上。

不一会儿功夫,一只站在冲浪板上的山羊丹青好了。

轻量模子

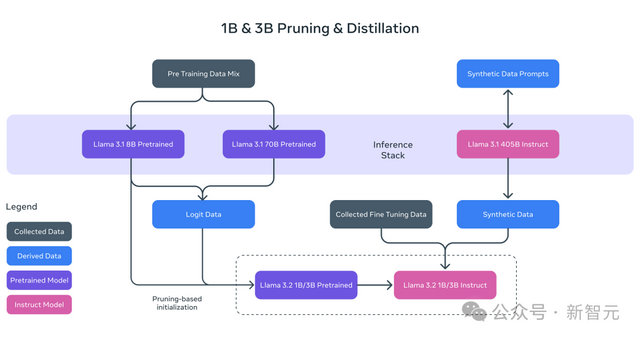

通过驾驭剪枝(pruning)和蒸馏(distillation)这两种法子,Meta让全新的1B和3B模子,成为了首批八成高效地相宜成立的、具有高才调的轻量级Llama模子。

剪枝八成减小Llama的范围,并尽可能地保留常识和性能

在此,Meta接收了从Llama 3.1 80亿参数模子进行单次结构化剪枝的法子。也便是,系统地移除网罗的部安分容,并退换权重和梯度的幅度,从而创建一个更小、更高效的假话语模子,同期保留原始网罗的性能。

完成剪枝之后,则需要使用常识蒸馏来收复模子的性能。

常识蒸馏是让一个更大的网罗给更小的网罗传授常识

也便是,较小的模子不错借助考验模子的指引,得到比从新驱动历练更好的性能。为此,Meta在预历练阶段融入了来自Llama 3.1 8B和70B模子的logits(模子输出的原始计算值),并将这些较大模子的输出则用作token级的琢磨。

后历练阶段,Meta接收了与Llama 3.1肖似的法子——通过在预历练假话语模子基础上进行多轮对皆来生成最终的聊天模子。

其中,每一轮都包括监督微调(SFT,Supervised Fine-Tuning)、拒却采样(RS,Rejection Sampling)和凯旋偏好优化(DPO,Direct Preference Optimization)。

在这期间,Meta不仅将模子的波折文长度膨大到了128K token,而况还驾驭经过仔细筛选的合成数据和高质料的搀和数据,对诸如讲究、重写、指示跟从、话语推理和器具使用等多项才调进行了优化。

为了便于开源社区更好地基于Llama进行革命,Meta还与高通(Qualcomm)、联发科(Mediatek)和Arm张开了密切合营。

值得一提的是,Meta此次发布的权重为BFloat16面容。

Llama Stack刊行版

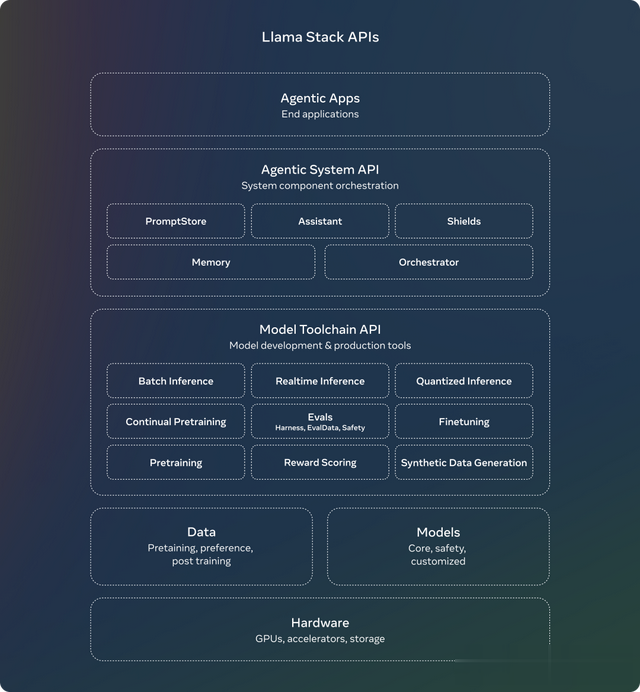

Llama Stack API是一个表率化接口,用于表率器具链组件(如微调、合成数据生成等)以定制Llama假话语模子并构建AI智能体应用。

自从本年7月Meta建议了有关的见解征求之后,社区反响相称犀利。

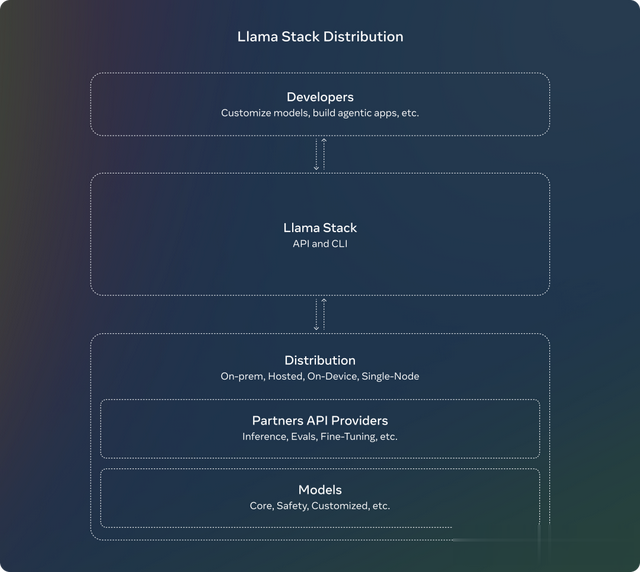

如今,Meta沉着推出Llama Stack刊行版——可将多个八成邃密协同责任的API提供者打包在总计,为设备者提供单一接入点。

这种简化且一致的使用体验,闪设备者八成在多种环境中使用Llama假话语模子,包括土产货环境、云霄、单节点工作器和结尾成立。

完满的发布本体包括:

Llama CLI:用于构建、建立和运行Llama Stack刊行版

多种话语的客户端代码:包括Python、Node.js、Kotlin和Swift

Docker容器:用于Llama Stack刊行版工作器和AI智能体API供应商

多种刊行版:

单节点Llama Stack刊行版:通过Meta里面杀青和Ollama提供

云霄Llama Stack刊行版:通过AWS、Databricks、Fireworks和Together提供

成立端Llama Stack刊行版:通过PyTorch ExecuTorch在iOS上杀青

土产货部署Llama Stack刊行版:由Dell提供援救

系统安全

此次,Meta在模子安全方面主要进行了两个更新:

1.Llama Guard 3 11B Vision

它援救Llama 3.2的全新图像贯穿才调,并能过滤文本+图像输入领导词或对这些领导词的文本输出反应。

2. Llama Guard 3 1B

它基于Llama 3.2 1B,并在剪枝和量化处理之后,将模子大小从2,858MB缩减至438MB,使部署效果达到前所未有的高度。

当今,这些新处分决策依然集成到了Meta的参考杀青、演示和应用环节中仁科百华qvod,开源社区不错立即驱动使用。

Powered by Hongkongdoll @2013-2022 RSS地图 HTML地图

Copyright Powered by站群 © 2013-2024